A ativação AI Monitoring permite que o agente reconheça e capture métricas de desempenho e trace dados sobre a camada de IA do seu aplicativo. Com AI Monitoring, você pode rastrear o uso token , o número de conclusões e o tempo de resposta da IA em seu aplicativo com tecnologia de IA. Ao ver um erro ou uma resposta imprecisa, você pode definir o escopo de uma visualização em nível de traceem uma determinada interação de resposta promptpara identificar problemas na lógica do seu serviço de IA.

Você pode visualizar seus dados acessando one.newrelic.com > All Capabilities > AI monitoring. Você pode ver seus dados em três páginas diferentes:

AI responses

: Visão geral dos dados agregados de toda a sua entidade AI. Acompanhe o tempo de resposta e o token da IA ou veja dados sobre solicitações e respostas individuais.

AI entities

: Visualize um resumo da tabela de todas as entidades que reportam dados de IA. Consulte entidade com dados padrão APM , como taxas de erros, taxas de transferência e app tempo de resposta. Ao selecionar uma entidade, você pode começar a explorar a página AI responses do APM .

Página de respostas de IA

A página AI responses de nível superior mostra seus dados de IA de forma agregada. Os dados agregados consideram o total médio de respostas, o tempo de resposta e o uso token por resposta em todas as entidades que reportam dados de IA. Nesta página, resposta refere-se a uma saída do seu aplicativo com tecnologia de IA quando recebe um prompt.

Se você possui vários aplicativos com várias implementações de diferentes estruturas de IA, poderá ter uma noção geral do desempenho do seu modelo de IA.

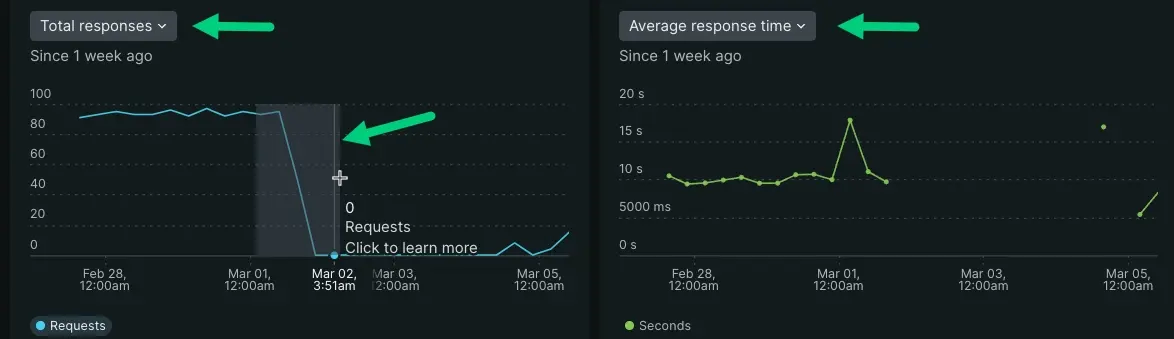

Acompanhe o total de respostas, o tempo médio de resposta e o uso de token

Os três blocos mostram métricas gerais de desempenho sobre as respostas da sua IA. Esses blocos podem não informar a causa exata de um problema, mas são úteis para identificar anomalias no desempenho do seu aplicativo.

- Se você notar uma queda no total de respostas ou um aumento no tempo médio de resposta, isso pode indicar que alguma tecnologia em sua cadeia de ferramentas de IA impediu que seu aplicativo com tecnologia de IA publicasse uma resposta.

- Uma queda ou aumento no uso médio token por resposta pode fornecer insights sobre como seu modelo cria uma resposta. Talvez esteja extraindo muito contexto, aumentando assim o custo do token ao gerar sua resposta. Talvez suas respostas sejam muito escassas, levando a custos de token mais baixos e respostas inúteis.

Ajustar os gráficos de série temporal

Você pode consultar os gráficos de série temporal para visualizar melhor quando um comportamento análogo aparece pela primeira vez.

- Ajuste o gráfico da série temporal arrastando um pico ou uma gota. Isso abrange a série temporal para uma determinada janela de tempo.

- Selecione o menu suspenso para executar uma análise comparativa para diferentes parâmetros de desempenho. Você pode escolher entre total de respostas, tempo médio de resposta ou token médio por resposta.

- Se você ativou o recurso de feedback, poderá definir o escopo dos gráficos para analisar as respostas por feedback positivo e negativo.

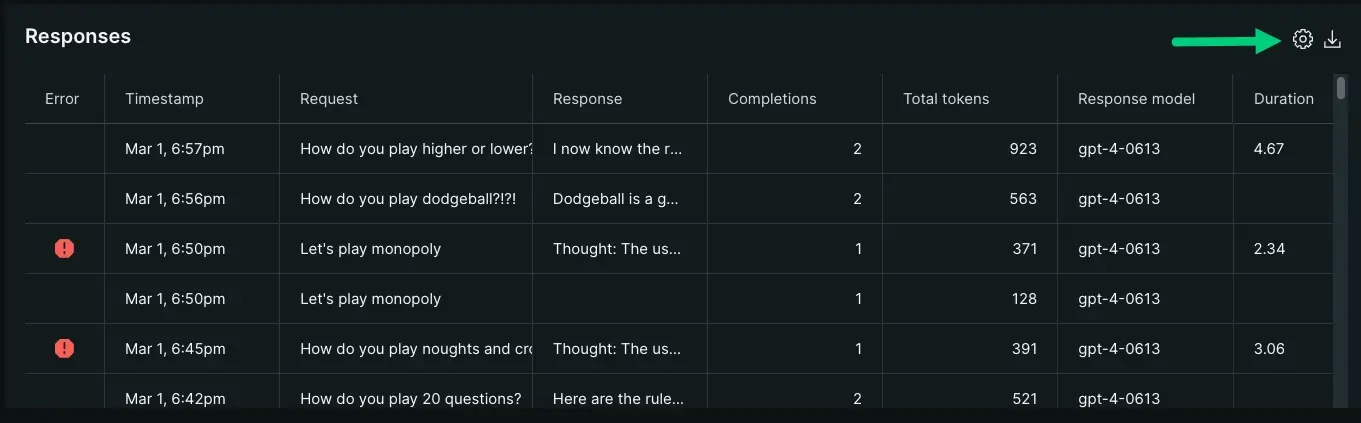

Avalie respostas individuais de IA

Sua tabela de respostas de IA organiza dados sobre a interação entre seu usuário final e o aplicativo de IA. Você pode visualizar quando ocorreu uma interação, o prompt emparelhado com suas respostas, a conclusão e a contagem token , e qual modelo recebeu um prompt.

Você pode ajustar as colunas da tabela clicando no ícone de engrenagem no canto superior direito. Isso permite que você escolha os tipos de dados que deseja analisar.

A tabela de resposta é um ponto de entrada para visualizar dados trace sobre uma resposta individual. Clique em uma linha na tabela para abrir a visualização trace de uma resposta específica.

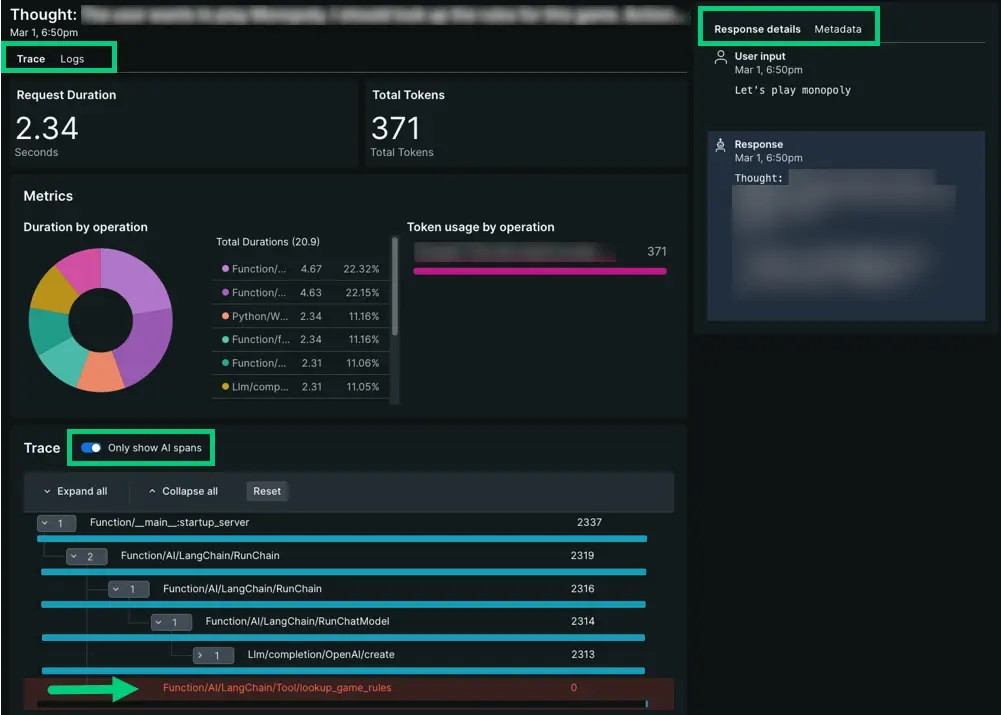

Visualização do rastreamento de resposta da IA

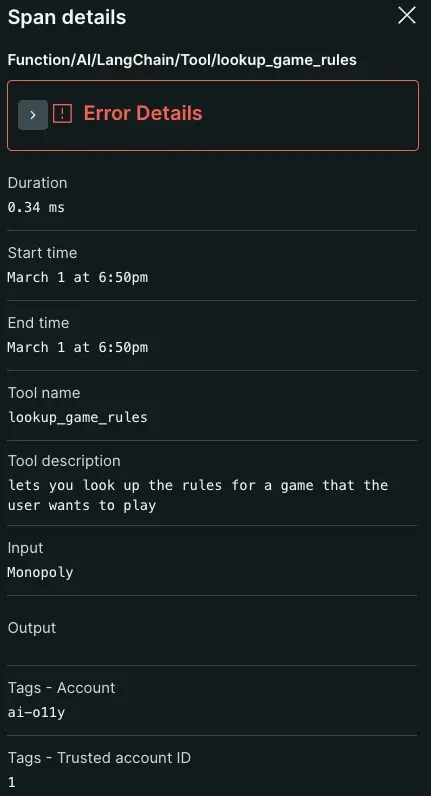

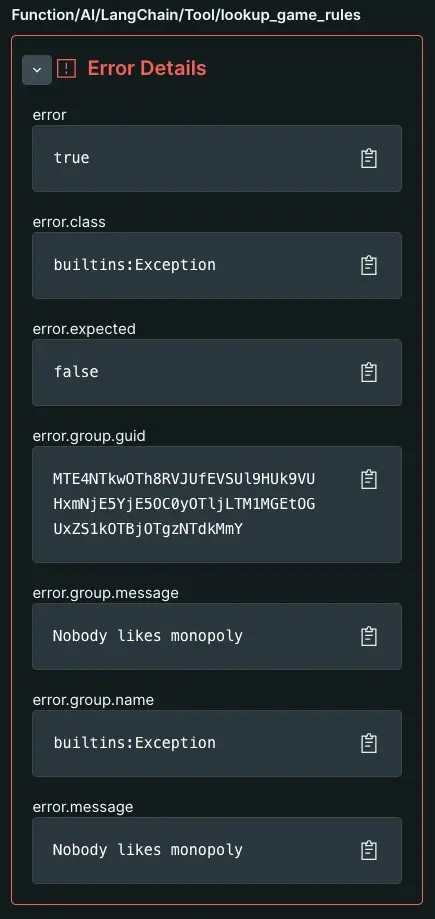

A visualização de rastreamento de resposta da IA fornece em tracenível de insights sobre como seu aplicativo gera respostas. Talvez você queira examinar a visualização trace para identificar onde ocorreu um erro ou talvez queira entender o que levou ao feedback negativo de uma resposta token alto. Na visualização trace , você pode:

Escolha entre rastreamento ou log. Ao selecionar log, consulte o log em busca de strings de texto ou atributos que você deseja investigar mais detalhadamente.

Alterne entre detalhes de resposta ou metadados. A coluna de detalhes da resposta mostra o prompt do usuário e a resposta da IA para que você possa manter o contexto para seu rastreamento e períodos. metadados fornece uma visualização de lista para GUID, modelo, token e fornecedor da entidade.

Quando ocorre um erro, a visualização em cascata destaca sua linha em vermelho. Selecione a linha para abrir os dados do intervalo, incluindo os detalhes do erro do intervalo.

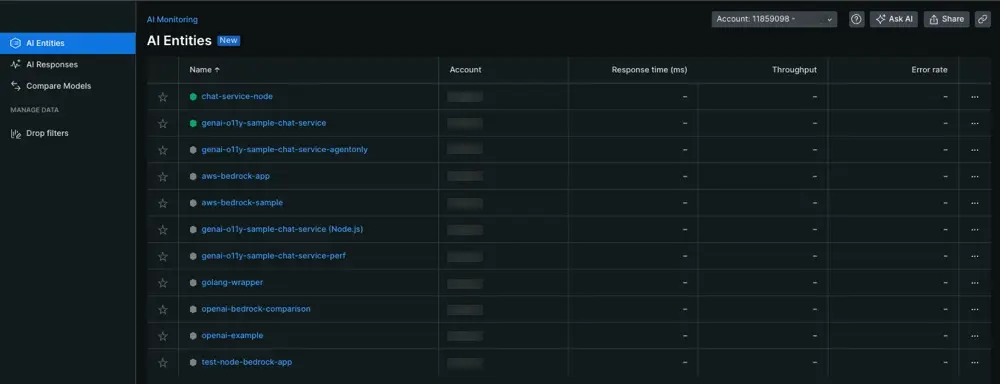

Página da entidade AI

A página da entidade AI organiza todas as suas entidades que atualmente reportam dados de IA em uma tabela. Esta página exibe seus aplicativos de IA juntamente com tempo de resposta, taxas de transferência e taxas de erros.

Veja a entidade que reporta dados de IA: Vá para one.newrelic.com > Todas as Capacidades > AI Monitoring

A seleção de uma entidade de IA leva você à página de resumo do APM desse aplicativo. Em APM summary page, selecione AI monitoring na navegação esquerda.

Página de respostas do APM AI

A seleção de uma entidade de IA leva você à página de resumo do APM. Para encontrar seus dados de IA, escolha AI responses no painel de navegação esquerdo. Recomendamos usar esta página quando você identificar que uma determinada entidade AI contribuiu para a anomalia.

- A versão APM das respostas de IA contém os mesmos blocos, gráficos de série temporal e tabelas de respostas coletados como a página de respostas de IA de nível superior.

- Em vez de mostrar dados agregados, a página de respostas APM AI mostra dados com escopo para o serviço selecionado na entidade AI.

- Embora a página de respostas de IA de nível superior permita filtrar por serviço em todas as entidades de IA, a página de respostas de IA APM limita a funcionalidade de filtro ao próprio atributo do aplicativo.

Para revisar como explorar seus dados de IA, você pode seguir os mesmos padrões explicados na seção anterior de respostas de IA.

Qual é o próximo?

Agora que você sabe como encontrar seus dados, pode explorar outros recursos que AI Monitoring tem a oferecer.

- Quer analisar dados sobre ligações realizadas para o seu modelo de IA? Confira nosso documento sobre o inventário de modelos e as páginas de comparação de modelos.

- Preocupado com informações confidenciais? Aprenda a configurar filtros de queda.

- Se você quiser encaminhar informações de feedback do usuário sobre as respostas de IA do seu aplicativo para New Relic, siga nossas instruções para atualizar o código do seu aplicativo para obter feedback do usuário na interface.