AIモニタリングは、AI向けアプリケーションモニタリング( APM )のソリューションです。 AI モニタリングを有効にすると、 APMエージェントにより、OpenAI、Bedrock、DeepSeek などのベンダーがサポートするモデルのパフォーマンス、コスト、品質をエンドツーエンドで可視化できます。 ユーザーが AI アシスタントとどのように対話するかを調べ、AI イベントに対するモデルの応答に関するトレース レベルの詳細を掘り下げ、アプリ環境間でさまざまなモデルのパフォーマンスを比較します。

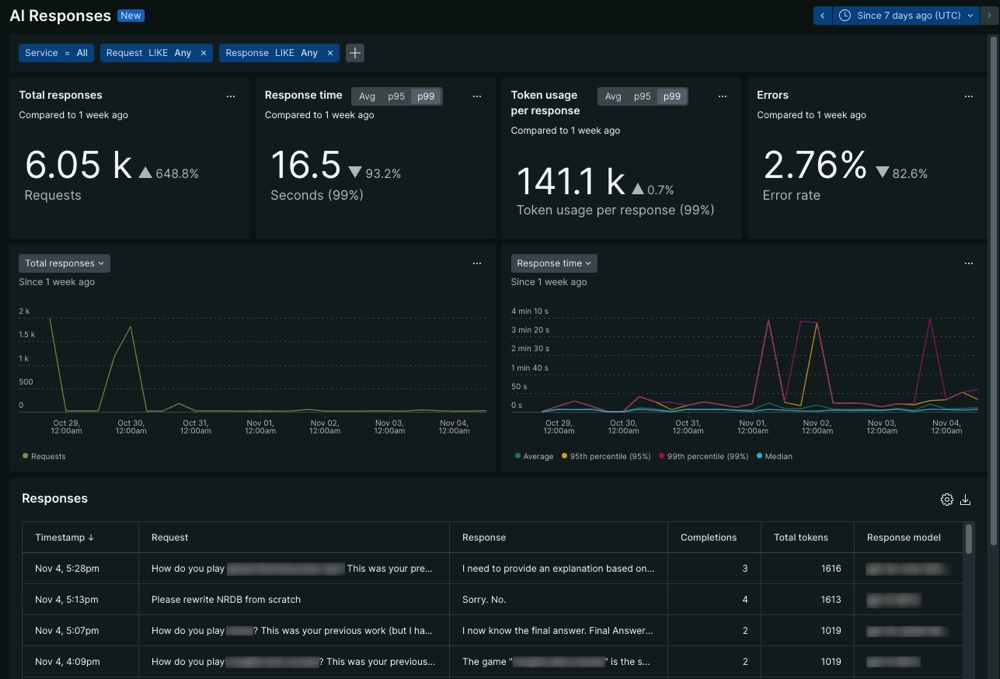

one.newrelic.com > AI monitoring > AI responsesに移動します。

AIモニタリングはどのように機能するのでしょうか?

AI モニタリングを開始するには、 APMエージェントの 1 つを使用して AI を利用したアプリを計測します。 アプリをインストゥルメントした後、エージェントが LLM オブザーバビリティ データをキャプチャできるように AI モニタリングを有効にすることができます。

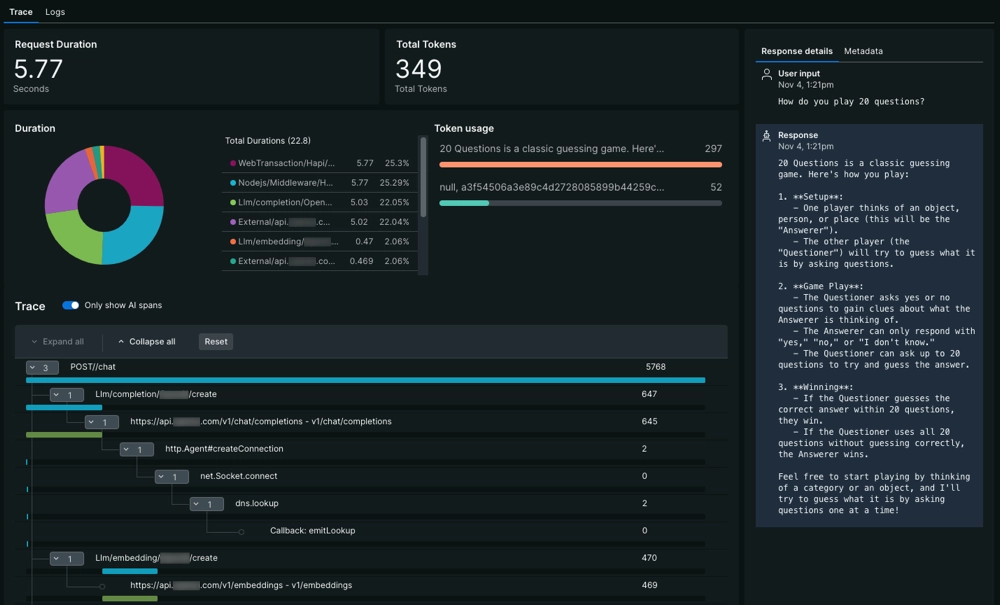

AI アシスタントがプロンプトを受信して応答を返すと、エージェントは外部 LLM およびベクター ストアから生成されたメトリクス データとイベント データをキャプチャします。 当社のエージェントは次のことができます:

- 完了、プロンプト、応答トークンに関する情報を解析する

- サポートされているモデルを通過するリクエストと応答を追跡します

- エンドユーザーからの反応に関する否定的または肯定的なフィードバックを相関させる

New Relic プラットフォームからこれらすべての情報などにアクセスし、アラートとダッシュボードを作成して AI データを効果的に管理し、パフォーマンスを向上させることができます。

AIモニタリングによるAIパフォーマンスの向上

AI を利用したアプリのパフォーマンスを概要するには、 one.newrelic.com > AI monitoring > AI responsesに移動します。

AI モニタリングは、AI アプリのパフォーマンスに関する重要な質問、つまりエンドユーザーが応答を待つ時間が長すぎますか? に答えるのに役立ちます。 最近トークンの使用量が急増していますか? 特定のトピックに関して、ユーザーからの否定的なフィードバックのパターンはありますか? AI モニタリングを使用すると、AI 層に固有のデータを確認できます。

- 応答テーブルから特定のプロンプトと応答インタラクションのエラーを特定します。 AI モデルを改善したい場合は、トレース レベルのデータを使用してモデルを分析する方法を学習してください。

- アプリ環境間で異なるモデルを使用している場合は、デプロイする前にアプリのコストとパフォーマンスを比較できます。

- データのコンプライアンスについて懸念がありますか? 機密データを New Relic に送信する前にドロップ フィルターを作成してドロップする方法を学びます。

AIモニタリングを始める

始める準備はできましたか? AI ライブラリまたはフレームワークが計装できることを必ず確認してください。 すでにアプリをインストゥルメントした場合は、エージェントを更新する必要がある場合があります。

準備ができたら、ドキュメントを使用してAI モニタリングを手動でインストールします。 このドキュメントでは、APM エージェントをインストールするための関連手順を説明し、エージェント AI モニタリングの構成について説明します。